損害保険ジャパン株式会社のプレスリリース

損害保険ジャパン株式会社(代表取締役社長:石川 耕治、以下「損保ジャパン」)は、2024年10月から、大規模言語モデル(LLM)を活用した照会回答業務支援システム「おしそんLLM(仮称)※1」のトライアル運用を開始しました。

最先端のテクノロジーを活用し本社や営業店における照会対応業務の効率化を図ることで、社員の生産性向上および創出された時間を使ったお客さまへの新たな価値提供を目指します。

※1「おしそんLLM(仮称)」は社内ナレッジ検索システム「教えて!SOMPO」の略称とLLMを組み合わせたもの。

2019年11月13日ニュースリリース

https://www.sompo-japan.co.jp/-/media/SJNK/files/news/2019/20191113_1.pdf

1.背景・目的

損保ジャパンにおいては、代理店・営業店・本社間における保険の引受・規定にかかわる照会対応の効率化と利便性の向上が課題となっていました。

2017年には、散在するQ&A等を自然文で横断検索し、解決できない場合はそのまま照会できるナレッジ検索システム「教えて!SOMPO」の使用を開始しました。課題解決力は向上した一方で、コンテンツ作成とメンテナンスの負荷軽減も課題として認識されていました。これらの課題解決を図るため、LLMを活用した「おしそんLLM」を開発し、トライアル運用を開始します。

2.「おしそんLLM」の概要

「おしそんLLM」は、損保ジャパンが保有する膨大な規定が記載されたマニュアルやQ&Aデータなどを学習し、照会内容に最適な回答案を自動生成するシステムです。

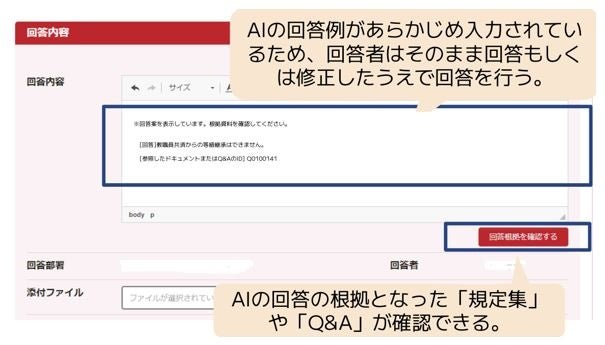

本システムでは、生成AIが作成した回答案およびその回答案の参照先文書が回答者の画面に表示されます。生成AIが作成した回答案と参照先文書をもとに回答者が最終的な回答内容を作成することができるため、回答者は一から文章を作成する作業が不要となり、照会対応における業務時間が削減されます。

膨大な社内文書を生成AIへ投入するにあたり、テキストの構造化や「RAG技術(AIに独自の情報源を付与する仕組み)」を活用することで回答精度を高めています。システム設計にあたっては「ヒューマンインザループ(データの収集やフィードバックにおいて人間が介在する仕組み)」のコンセプトを導入することで効率的な学習データの収集による精度向上および生成AIによる誤回答のリスクを軽減しています。

損保ジャパンでは、これらのシステムはエンジニアを中心に構成される内製チームで開発しており、ユーザーの改善要望や利用ログの分析からアジャイルにシステムを改善することで精度向上やにつなげていきます。

また、システムの性能向上のため、本システムで採用している生成AIモデルに対して Robust Intelligence社が提供するプラットフォームを活用し、品質・倫理・セキュリティなどさまざまな観点から設計された多数のテストによるリスク評価を実施※2して生成AI利用における安全性を確保しています。

※2 2023年10月25日ニュースリリース:https://www.sompo-hd.com/-/media/hd/files/news/2023/20231025_1.pdf

「損保ジャパンとRobust Intelligenceが業務提携

〜AIの信頼性確保に向けた大規模言語モデルのリスク評価と全社的なガバナンス体制の構築〜 」

<利用画面イメージ>

3.トライアルの概要

2024年10月から営業店担当者や本社担当者など全国約1,000名を対象にトライアルを実施します。

開始当初は自動車保険、賠償責任保険など一部の保険種目のみでのトライアルですが、ユーザーの規模や対応する保険種目についても段階的な拡大を予定しています。

4.今後について

今回のトライアルを通じて、社員からのフィードバックを収集し、システムの精度向上や機能拡充を進めるとともに、業務効率化効果を検証します。将来的には、トライアルの結果を踏まえ全店への導入を検討し、さらなる生産性向上および顧客サービスの拡充を目指します。

以上